人工知能技術の急速な発展に伴い、ますます多くの企業や開発者が、特定のニーズを満たすのに適した AI モデルを選択する方法に注目し始めています。DeepSeek の V3 と R1 は、注目を集めている 2 つの大規模モデルであり、それらは設計目標、技術アーキテクチャ、およびアプリケーションシーンで顕著な違いがあります。この記事では、この 2 つのモデルを詳しく比較し、読者がそれらの特徴と適用シーンをよりよく理解するのを助けます。

モデルの位置づけとコア機能の比較

コアな位置づけ

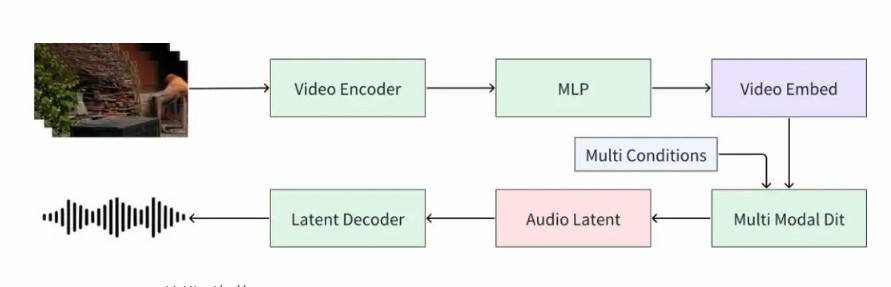

- DeepSeek V3:テキスト、画像、音声など、マルチモーダルな大規模モデルであり、多くの分野のタスクをカバーしています。スマートカスタマーサービス、マルチランゲージ翻訳、ショートビデオスクリプトの生成など、高速応答と高スループット処理が必要なシーンに適しています。

- DeepSeek R1:複雑なロジック推理に専念し、数学、コード生成、科学計算など、高レベルのシーンに焦点を当てています。強化学習を通じて推理能力を引き出し、透明な思考チェーンの出力を実現し、金融リスクコントロールモデリング、科学研究計算、アルゴリズミックトレーディングストラテジーの最適化などに適しています。

技術目標

- DeepSeek V3:性能とコストのバランスを図り、長文(128Kコンテキストウィンドウ)と高スループット処理をサポートします。

- DeepSeek R1:強化学習を通じて推理能力を引き出し、透明な思考チェーンの出力を実現します。

主要な革新

- DeepSeek V3:

- マルチモーダルな隠れ層アテンション(MLA)

- FP8混合精度トレーニング

- DeepSeek R1:

- 動的ゲート付きエキスパートスケジューリング

- 自己進化知識ベース(1.2億の推理チェーン)

典型的なアプリケーション

- DeepSeek V3:

- スマートカスタマーサービス

- マルチランゲージ翻訳

- ショートビデオスクリプトの生成

- DeepSeek R1:

- 金融リスクコントロールモデリング

- 科学研究計算(CT画像分析など)

- アルゴリズミックトレーディングストラテジーの最適化

パラメータの規模の範囲

- DeepSeek V3:1.5B-671B

- DeepSeek R1:1.5B-671B(蒸溜バージョンを含む)

アーキテクチャデザインとトレーニングメソッド

アーキテクチャの違い

-

DeepSeek V3:

-

パラメータの規模:6710億(MoEアーキテクチャ)、各トークンが370億のパラメータを活性化する

-

主要な技術:

-

マルチヘッド隠れ層アテンション(MLA)はKVキャッシュを1/4に圧縮する

-

負荷均衡は93.7%のエキスパート利用率を実現する

-

ハードウェアの適合性:AMD GPU、Huawei Ascend NPUをサポートし、vLLMフレームワークを統合する

-

-

DeepSeek R1:

-

パラメータの規模:蒸溜バージョン(1.5B-70B)をサポートし、エキスパートネットワークの規模を動的に調整する

-

主要な技術:

-

スパースエキスパートシステム(128のドメインエキスパート)

-

リアルタイムインクリメンタルラーニング(知識の更新速度を5倍向上させる)

-

ハードウェアの適合性:ローカルデプロイメントをサポートし、スループットを3倍向上させる動的バッチ処理技術

-

トレーニングメソッドの比較

-

DeepSeek V3:

-

事前トレーニング:14.8兆トークンデータ、FP8混合精度最適化、コストは557.6万ドル

-

ファインチューニングステージ:監督ファインチューニング(SFT)+マルチトークン予測(コード補完速度を3.8倍向上させる)

-

最適化アルゴリズム:マルチトークン予測 + 負荷均衡を支援するための補助損失なし

-

-

DeepSeek R1:

-

事前トレーニング:コールドスタート技術、思考チェーンサンプル200個で初期ネットワークを起動する

-

ファインチューニングステージ:SFTを完全に捨てる、2段階の強化学習(従来のRLHFよりも収束速度が4.3倍速い)

-

最適化アルゴリズム:グループ相対戦略最適化(GRPO)、トレーニングの安定性を65%向上させる

-

パフォーマンスとベンチマークテスト

量的パフォーマンスの比較

| テストセット | V3のスコア | R1のスコア | 比較モデル(GPT-4o) |

|---|---|---|---|

| AIME 2024(数学) | 68.7% | 79.8% | 78.5% |

| MATH-500(数学推理) | 89.4% | 97.3% | 96.8% |

| DROP(ロジカルリーズニング) | 82.1% | 92.2% | 90.5% |

| HumanEval(コード) | 65.2% | 72.8% | 71.3% |

| MMLU(知識理解) | 85.6% | 90.8% | 91.2% |

| GPQA Diamond(金融分析) | 65.3% | 71.5% | 70.8% |

シーンのパフォーマンスの優位性

-

DeepSeek V3:

-

長文生成:10万字のドキュメントを処理するとき、Llama3よりも遅延が58%低い

-

マルチランゲージ翻訳:50の言語をリアルタイムで相互翻訳をサポートし、伝統的なモデルよりもBLEUスコアが12.7%高い

-

-

DeepSeek R1:

-

金融リスクコントロール:誤判定率はわずか2.7%で、汎用モデルの12.3%よりも低い

-

科学研究計算:タンパク質折りたたみ予測タスクで、精度はAlphaFold2よりも9%高い

-

アプリケーションシーンとデプロイメントコスト

シーンの適合性

| 分野 | V3の適合性 | R1の適合性 |

|---|---|---|

| 企業カスタマーサービス | ★★★★★ | ★★☆ |

| コンテンツ制作 | ★★★★☆ | ★☆ |

| 金融分析 | ★★☆ | ★★★★★ |

| 工業品質検査 | ★★★☆ | ★★★★★ |

コストの比較

| コスト項目 | V3の価格(人民元/百万トークン) | R1の価格(人民元/百万トークン) |

|---|---|---|

| 入力トークン(キャッシュヒット) | 0.5元 | 1元(キャッシュヒット)/4元(未ヒット) |

| 入力トークン(キャッシュ未ヒット) | 2元 | 上記同様 |

| 出力トークン | 8元 | 16元 |

構成の選択の参考

-

個人開発者/学生:R1蒸溜バージョン(1.5B-7B)+ NVIDIA RTX 4060グラフィックカードを優先する。

-

中小企業:V3 7B/14B + AMD EPYC CPUを推奨し、コストとパフォーマンスのバランスを取る。

-

科学研究機関/大企業:R1 32B/70B + A100クラスタを採用し、複雑な推理のニーズを満たす。

オープンソースエコシステムと拡張能力

オープンソースのライセンス

-

DeepSeek V3:MITライセンスでウェイトを開き、商業用途をサポートする。

-

DeepSeek R1:Qwen/Llamaに基づく蒸溜バージョン(1.5B-70B)を提供する。

ハードウェアの適合性

-

DeepSeek V3:AMD GPU、Huawei NPUをサポートする。

-

DeepSeek R1:NVIDIA GPUを優先する。

デベロッパーツール

-

DeepSeek V3:vLLM、DeepSpeedなどのフレームワークを統合する。

-

DeepSeek R1:推理チェーンの可視化ツールと知識ベースの管理インターフェイスを提供する。

サマリーと選択の提案

主要な違いのサマリー

-

技術ルート:V3はMoEアーキテクチャで汎用性を実現し、R1は強化学習を通じて推理に専念する。

-

コスト効果:V3は中小規模のデプロイメントに適し、コストが低い一方で、R1は高レベルのシーンでROIが優れており、コストが高い。

-

能力の境界:V3はマルチモーダル処理に長けており、R1は複雑なロジックタスクで不可欠です。

選択のための決定ツリー

専門的な推理が必要ですか?

├─ はい → R1を選択(金融/科学のシーン)

└─ いいえ → V3を選択(カスタマーサービス/コンテンツ制作のシーン)

↓

ローカルデプロイメントが必要ですか?

├─ はい → R1蒸溜バージョン(14B以下のモデル)

└─ いいえ → V3クラウドAPIaiスピーキング

ドルフィンAIは言語学習アプリケーションのためのプロフェッショナルな発音評価API(pronunciation assessment api)ソリューションを提供します。音素、単語、文章、チャプター、発音矯正、単語矯正、クイズ、フリーダイアログ、多肢選択問題など幅広く提供しています。当社の発音評価製品(pronunciation assessment)は、英語と中国語、クラウドAPI、オンプレミス、オフラインデバイスの展開をサポートしています。当社の発音評価API(pronunciation assessment api)は、正確性、流暢性、完全性、リズムの次元をカバーする豊富な評価指標を提供し、音素、単語、文の異なるレベルの評価スコアも提供します。また、音素、単語、文の異なるレベルでの評価スコアも提供します。数千万人のユーザーに安定した効率的で安全なサービスを提供しています。ドルフィンAIの発音評価製品(pronunciation assessment)を試してみませんか?